每次说什么配置,好像很多人都不明白AR眼镜里的各种“高大上”配件,还有就是把很多概念混为一谈,但是作为一个合格的AR人,我们是不是要把这些基本概念理清楚了再去和客户爸爸说呢?

手机AR是AR吗?

实际上我们玩过不少“手机AR”的游戏或者应用,比如说得最多的支付宝扫五福,包括也有不少基于微信小程序所开发的AR应用,但严格来说,这些都是「伪AR」。

AR,Augmented Reality增强现实,是对现实世界的信息增强,那么最重要的一点就是要将虚拟信息叠加在现实中,起到对现实世界的信息增强的作用。在这个过程中最重要的就是「识别+叠加」的能力,但手机并不是真正的「识别现实世界并叠加在现实世界」。

确实我们在网上看到过不少类似于基于苹果ARKit所设计出来的AR应用,但和眼镜所代表的真正的AR区别究竟在哪里呢?

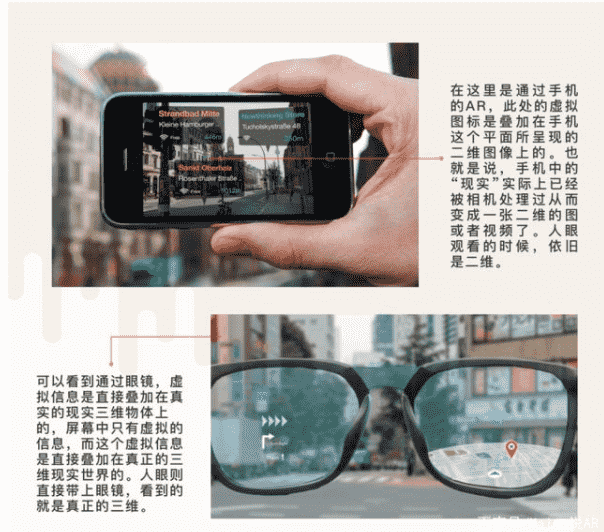

我们在通过手机看到AR的时候,看到的是手机屏幕中的二维图像或视频,然后虚拟的信息叠加在这个二维图像或视频上;但通过眼镜来看AR的话,我们所看到的AR则是虚拟信息叠加在真真切切的三维真实物体上的。

换句话说,也就是当我们通过手机去看AR时,已经经过一次手机镜头了,从视觉上来说,仅仅只是虚拟叠加在屏幕中的二维图像或视频中;但通过眼镜,我们看到的是实实在在的「虚拟」叠加在「现实」上,这才符合AR的定义。

全景真的是VR吗?

VR,Virtual Reality虚拟现实,顾名思义提供的是虚拟的环境,并且众所周知,VR的一大特点是要求沉浸感,此外,3D及6DoF是最基本的要求。但全景VR真的是VR吗?

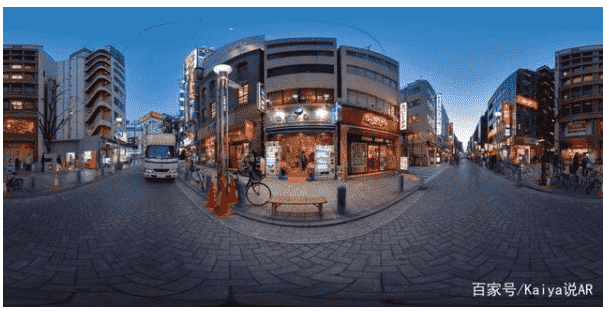

从刚才所提到最重要的三个特征来说,全景视频应该是一个都不占。以目前比较常见的全景视频——链家VR看房来说,我们确实能够通过手机上的VR全景视频看到房子的各个细节,但仅限于在手机或者电脑中观看,这就还是上面提到的:我们依旧只是在看“假的3D视频”,因为它仅仅是在二维手机屏幕呈现,因此,它既不是真正的3D,也不具有沉浸感;其次,用户在观看全景视频时,无法在“虚拟的”房子中走动,只能通过点击点位来切换视角,也就是无法实现6DoF。所以,全景VR不是真正意义上的VR。

下面是一个关于全景和VR的对比

三维重建和SLAM是一个东西吗?

SLAM这个概念其实已经解释过挺多次了,但可能还是有人不知道是什么,毕竟上次就被问过什么是SLAM……

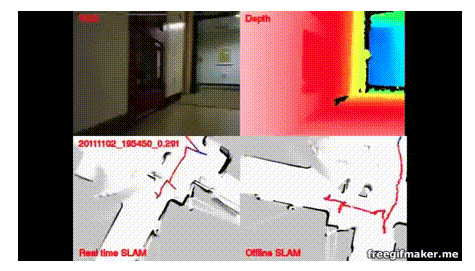

SLAM(simultaneous localization and mapping)实时定位与地图构建,这个概念最早是在机器人领域运用的比较多,后来逐渐应用到AR、无人驾驶领域。

对于这个概念,机器人领域有一个非常通俗易懂的描述:我们将一个机器人放到它所未知的环境中,通过一边移动一边描绘出该环境所对应的地图。那么实际上在整个机器人移动的过程中,「定位」也就是自己处于该环境的什么位置,是最重要的。

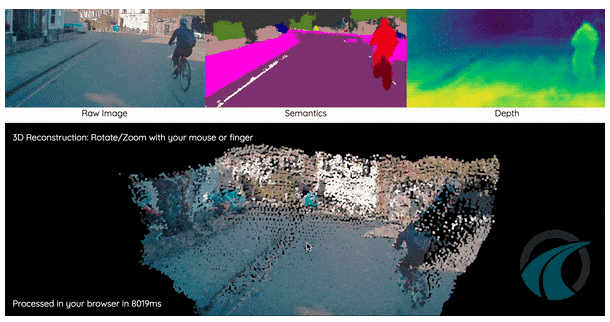

三维重建(3D Reconstruction)是指对三维物体建立适合计算机表示和处理的数学模型,是在计算机环境下对其进行处理、操作和分析其性质的基础,也是在计算机中建立表达客观世界的虚拟现实的关键技术。可以看到,三维重建是尽可能高精度的还原实体,因此在这个过程中对环境的「精确」建模才是最重要的。

从上述的分析中,基本上就能明白SLAM和三维重建各自的侧重点,其实是不一样的。就目前的技术来说,无法同时做到SLAM和三维重建。因此,暂时可以说SLAM和三维重建不是一个东西。

ToF和LIDAR是一个东西吗?

首先我们要搞清楚ToF的概念,以及它在AR眼镜中究竟是起到了什么作用。

ToF(Time of Flight)译为飞行时间,譬如很多“飞行时间传感器”,就是ToF。那么这个东西是怎么工作的呢?

ToF相机通过红外发射器发射调制过的光脉冲(不一定是红外线),遇到物体反射后,用接收器接收反射回来的光脉冲,然后计算从发射到反射回摄像头的时间差或相位差,并将数据收集起来,形成一组距离深度数据,从而得到一个立体的3D模型的成像技术。在这个过程中,对于时间的测量要有非常高的精度要求。

而这个ToF,就是实现上述所说的三维重建的一部分关键要素。通过ToF,能够使AR眼镜感知周围环境,加上IMU和鱼眼摄像头追踪,就能够完整的实现更完美的SLAM。这也就是为什么我们看到目前性价比还不错的几款MR眼镜,基本都是这个配置。

LIDAR是由于今年iPad Pro推出时,被大众所注意到的一个概念。LIDAR(Light Detection and Ranging)即光探测和测距,激光雷达。

在苹果官方说明中,苹果解释了LiDAR的工作原理:通过测量光触及物体并反射回来所需的时间,从而确定距离。

是不是觉得和ToF就是一回事?

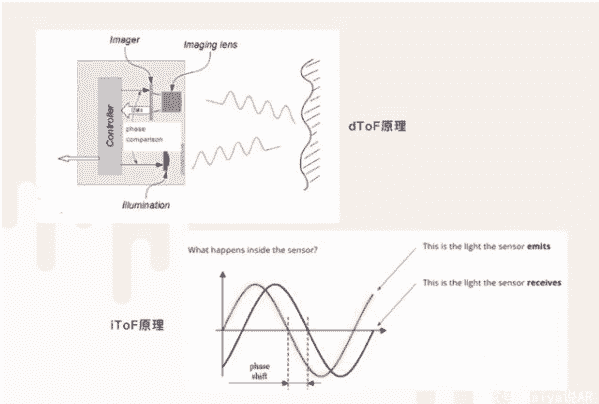

是的,LiDAR就是ToF的一种。但LiDAR属于ToF中的dToF(直接飞行传感器),而相对应的,还有另一种叫做iToF(间接飞行传感器)。dToF发出的是激光束,而iToF发出的是经过正弦波调制,明暗强度呈规律变换的光信号。但iToF的传感器反应速度没有dToF那么快,无法做到精确感知皮秒、纳秒级别的时间差。因此iToF 靠感知正弦波光信号的差异来「估算」其从发射到反射回来的距离。而dToF是激光直接测算距离。所以相比dToF,iToF只能在比较小的范围内测距。

目前智能手机大多是iToF,AR眼镜上多是dToF。

RGB摄像头?鱼眼摄像头?ToF摄像头?

RGB摄像头:每一个颜色都能用RGB(红,绿,蓝)三个变量来表示。摄像头通常是用三个独立的CCD传感器来获取三种彩色信号。顾名思义在AR眼镜中,RGB摄像头是用来做颜色采集的。

鱼眼摄像头:人眼集中注意力时所能看到的最大角度只有25度,但鱼眼摄像头能够接近180度,在常见的MR眼镜中,一般都是配备双鱼眼摄像头,配合IMU,能够进行6DoF追踪。而Hololens2则配备了4个。

来源: Kaiya说AR